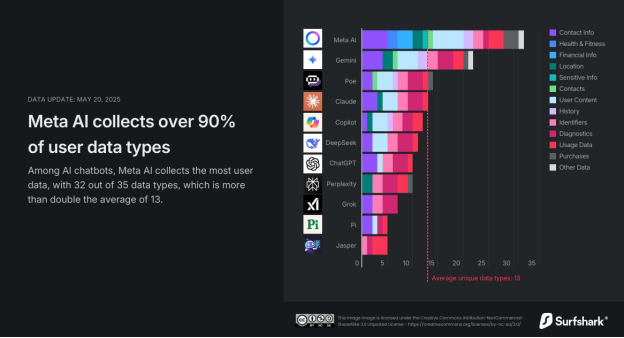

Secondo un’analisi di Surfshark, azienda specializzata in cybersicurezza, il chatbot di Meta raccoglie una quantità di dati personali mai vista prima tra le app di intelligenza artificiale. Con 32 su 35 categorie di dati collezionate, Meta AI si piazza al primo posto tra gli strumenti più invasivi e stacca nettamente Google Gemini, fermo a 22.

Oltre il 90% dei dati possibili

Meta AI è l’unica app tra quelle analizzate che attinge da ogni ambito della vita privata: informazioni finanziarie, sanitarie, legate al fitness e persino dati sensibili come orientamento sessuale, opinioni politiche, disabilità o appartenenze religiose. Nessun altro chatbot si avvicina a questi livelli di profilazione. Anche la finalità commerciale dell’uso dei dati è rilevante: Meta AI e Copilot sono le uniche due app che usano i dati legati all’identità dell’utente per mostrare pubblicità di terze parti. Ma se Copilot si ferma a due tipologie (ID del dispositivo e dati pubblicitari), Meta AI può arrivare a impiegarne fino a 24.

L’ecosistema Meta amplifica la raccolta

Secondo Karolis Kaciulis, system engineer di Surfshark, il chatbot Meta non è un’entità isolata ma parte di un ecosistema integrato con Facebook, Instagram e Audience Network. Meta AI è in grado di apprendere non solo dai dati inseriti nelle conversazioni, ma anche da post pubblici, foto e testi degli utenti. Per Kaciulis, questo rappresenta una grave violazione della privacy e un esempio di quanto sia urgente una regolamentazione delle AI generative.

Un confronto con gli altri chatbot

In media, i chatbot analizzati raccolgono 13 tipi di dati su 35. Solo il 45% delle app traccia la posizione degli utenti, e circa il 30% effettua tracciamenti pubblicitari. ChatGPT, ad esempio, si limita a raccogliere 10 categorie, senza usare pubblicità di terze parti o meccanismi di tracciamento. L’utente può anche scegliere di attivare chat temporanee o richiedere la cancellazione dei propri dati. Altri chatbot che effettuano tracciamenti sono Copilot, Poe e Jasper, ma con un’impronta inferiore rispetto a Meta. Gemini, dal canto suo, include dati di contatto, contenuti utente, cronologia di ricerca e navigazione, ma si ferma prima dei dati sensibili.

Dati come merce, anche nei chatbot

Kaciulis avverte: “Le persone oggi pagano gli abbonamenti, ma anche con i propri dati. Nell’UE, grazie al GDPR, i dati personali appartengono al cittadino, non alle aziende. Ma se vengono condivisi con un chatbot generativo, possono essere conservati e riutilizzati per fini ignoti, esponendo l’utente a rischi come la manipolazione personalizzata o il furto d’identità”. Una volta che un’AI apprende dai dati personali, non è più possibile “disimparare”. Per questo, conclude Surfshark, la prudenza resta l’unica arma concreta per difendere la propria integrità digitale in un contesto dove i dati sono trattati come valuta.

Fonti e metodologia

Lo studio ha preso in esame le schede privacy di 10 chatbot AI su App Store, aggiornate al 20 maggio 2025, con un’attenzione particolare su tracciamenti, pubblicità e legame dei dati con l’identità dell’utente. Sono state consultate anche le policy ufficiali di DeepSeek e ChatGPT.

Lascia un commento